¿Te has preguntado alguna vez qué significa inteligencia? Esta característica de los humanos abarca, pero no se limita a, el aprendizaje, el razonamiento, la resolución de problemas, la percepción y el uso del lenguaje. Estas son también las características en las que se han centrado los investigadores de la IA para encontrar soluciones para diversos aspectos de nuestra sociedad actual. En el que nos centraremos hoy es el uso de inteligencia artificial en ciberseguridad.

Inteligencia artificial en ciberseguridad: definición de IA

Enciclopedia Britannica describe la inteligencia artificial como «la capacidad de una computadora digital o un robot controlado por computadora para realizar tareas comúnmente asociadas con seres inteligentes. El término se aplica frecuentemente al proyecto de desarrollar sistemas dotados de los procesos intelectuales característicos de los humanos, como la capacidad de razonar, descubrir significados, generalizar o aprender de la experiencia pasada ”.

Algunos ejemplos de IA de los que todo el mundo podría haber oído hablar son los siguientes: asistentes inteligentes como Siri y Alexa, robots drones, chatbots, filtros de correo no deseado, canciones o recomendaciones de TV de Spotify y Netflix.

La inteligencia artificial se divide en dos categorías principales:

IA estrecha

La inteligencia artificial estrecha es una simulación de la inteligencia humana y opera solo dentro de un contexto limitado. Por lo general, incluso si las máquinas de IA estrechas parecen inteligentes, solo se enfocan en realizar una sola tarea de manera muy eficiente.

Inteligencia general artificial

La inteligencia artificial general se refiere a máquinas que tienen inteligencia general y que son capaces de aplicar esa inteligencia para resolver un problema.

Además, la IA se divide en varios tipos:

Fuente

1. Máquinas reactivas

Estos son los tipos más básicos de máquinas de IA, puramente reactivas, sin la capacidad de formar recuerdos o utilizar experiencias pasadas para situaciones actuales. Esto no significa que no sean impresionantes: Deep Blue de IBM, que venció al gran maestro internacional de ajedrez Garry Kasparov en la década de 1990, era una máquina reactiva. Percibió el mundo directamente, actuó en función de lo que vio y no se basó en un concepto interno del mundo.

2. Memoria limitada

Este segundo tipo de IA incluye máquinas que también pueden mirar al pasado. Este comportamiento ahora se puede encontrar en automóviles sin conductor, que necesitan monitorear la velocidad y dirección de otros participantes del tráfico, pero también en chatbots y asistentes virtuales.

3. Teoría de la mente

En psicología, la teoría de la mente se refiere al entendimiento de que las personas y las criaturas tienen pensamientos y emociones que influyen en su comportamiento. La teoría de la mente es crucial para la formación de nuestra sociedad ya que nos permite tener interacciones sociales: sería muy difícil para nosotros colaborar sin tener en cuenta los motivos, intenciones y conocimientos de otra persona sobre nosotros y el medio ambiente. Las máquinas de IA de este tercer tipo también deberían ajustar su comportamiento de acuerdo con estos factores.

4. Autoconciencia

Las máquinas conscientes de sí mismas representarían el último paso del desarrollo de la IA. Los seres conscientes de sí mismos son conscientes de sí mismos, de sus estados internos y son capaces de predecir lo que sentirían los demás.

Inteligencia artificial en ciberseguridad: desafíos

La ciberseguridad evoluciona constantemente, pero aún enfrenta desafíos, ya que La sociedad informática los describe muy bien:

Sistemas de TI geográficamente distantes—La distancia geográfica dificulta el seguimiento manual de incidentes. Los expertos en ciberseguridad deben superar las diferencias en la infraestructura para monitorear con éxito los incidentes en las regiones.

Búsqueda de amenazas manual—Puede ser costoso y llevar mucho tiempo, lo que resulta en ataques más inadvertidos.

Naturaleza reactiva de la ciberseguridad—Las empresas pueden resolver los problemas sólo después de que ya hayan ocurrido. Predecir las amenazas antes de que ocurran es un gran desafío para los expertos en seguridad.

Los piratas informáticos a menudo ocultan y cambian sus direcciones IP—Los piratas informáticos utilizan diferentes programas como redes privadas virtuales (VPN), servidores proxy, navegadores Tor y más. Estos programas ayudan a los piratas informáticos a permanecer en el anonimato y sin ser detectados.

En estas condiciones, la ayuda de AI es más que bienvenida.

Inteligencia artificial en ciberseguridad: ¿cómo puede ayudar?

AI y ML (aprendizaje automático, un subconjunto de AI que utiliza técnicas estadísticas para brindar a los sistemas informáticos la capacidad de aprender utilizando datos, sin programación) se han convertido en tecnologías cruciales en ciberseguridad porque pueden aprender con el tiempo y tienen la capacidad de detectar y responder desviaciones de las normas establecidas.

La inteligencia artificial puede analizar millones de eventos y detectar varios tipos de amenazas cibernéticas, desde malware hasta intentos de phishing: cuantos más datos analizan, más inteligentes se vuelven.

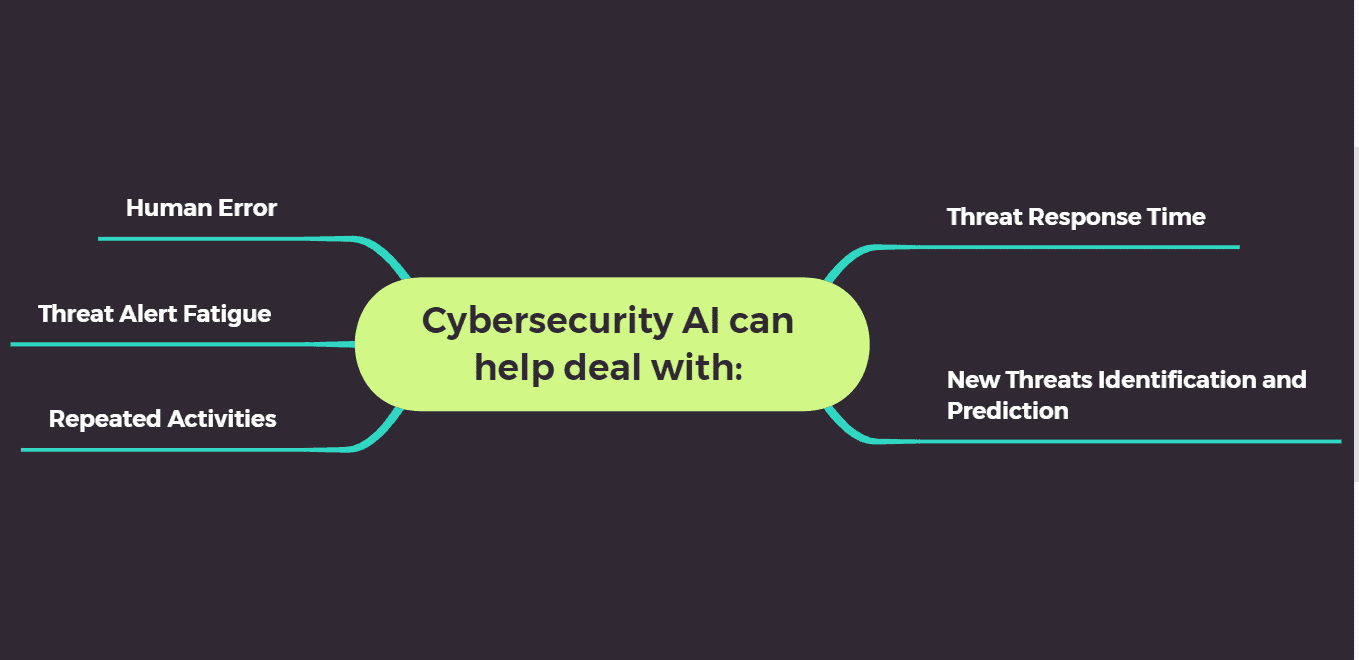

Las máquinas de IA pueden ayudar a las soluciones de ciberseguridad al lidiar con:

– error humano. Incluso el equipo de TI más experimentado puede cansarse si tiene que lidiar con demasiados procesos manuales. Las herramientas receptivas podrían ayudarlos a encontrar y mitigar problemas más fácilmente.

– actividades repetidas. Los procesos manuales no se pueden repetir perfectamente cada vez, por lo que es mejor que los sistemas de IA y ML se ocupen de las actividades repetitivas.

– fatiga de alerta de amenaza. Una estrategia de ciberseguridad decente debería implicar más capas; esto significa más fuentes de alertas de amenazas, lo que podría llevar a la fatiga de las decisiones si el personal de seguridad es quien debe decidir qué se debe hacer.

– tiempo de respuesta ante amenazas. El tiempo de respuesta ante amenazas es uno de los parámetros de eficiencia en ciberseguridad. La mayoría de los daños de los ciberataques ocurren en solo unos segundos, por lo que cualquier persona y cualquier cosa que tenga como objetivo ofrecer detección y protección debe trabajar aún más rápido. Desafortunadamente, la respuesta humana a una amenaza detectada a veces puede ser lenta. Las tecnologías de IA y ML pueden recopilar datos de inmediato y prepararlos para el análisis, ofreciendo informes simplificados y acciones recomendadas.

– identificación y predicción de nuevas amenazas. Las amenazas cibernéticas nuevas y desconocidas también son peligrosas porque pueden engañar a los equipos de TI y ralentizar sus reacciones o pueden pasar completamente desapercibidas. ML puede encontrar similitudes entre posibles nuevas amenazas y las identificadas previamente de manera más eficiente.

Inteligencia artificial en ciberseguridad – Beneficios

El uso de IA en software de ciberseguridad ofrece grandes ventajas, como:

a. Mejor detección de ciberataques

El análisis de comportamiento utilizado por las tecnologías de inteligencia artificial permite a las empresas evitar que ocurran amenazas en línea en primer lugar. Con la IA, el enfoque puede pasar de la remediación a la prevención.

segundo. Predicciones precisas

La IA permite mejores predicciones sobre posibles ataques futuros porque sus algoritmos pueden escanear datos rápidamente y analizarlos de acuerdo con cómo se entrena el sistema.

C. Respuesta mas rapida

El tiempo es un elemento crucial en la ciberseguridad, ya que la mayoría de las veces, solo se necesitan unos segundos sin prestar atención para convertirse en víctima de una amenaza de ciberseguridad. La IA permite a las empresas tomar contramedidas automáticas (ergo, más rápidas) para prevenir ciberataques y luchar contra las amenazas en línea.

Inteligencia artificial en ciberseguridad: inconvenientes

La inteligencia artificial puede hacer que las soluciones de ciberseguridad sean más eficientes y salvar a las empresas de todos los problemas que podría implicar un ciberataque: pérdida de tiempo, pérdida de ingresos, pérdida de clientes, daño a la reputación, medidas legales.

Sin embargo, hay ciertos inconvenientes:

RecursosLas empresas necesitan invertir mucho tiempo y dinero en recursos como potencia informática, memoria y datos para construir y mantener sistemas de IA.

Conjuntos de datos—Los modelos de IA se entrenan con conjuntos de datos de aprendizaje. Los equipos de seguridad deben tener en sus manos muchos conjuntos de datos diferentes de códigos maliciosos, códigos de malware y anomalías. Algunas empresas simplemente no tienen los recursos ni el tiempo para obtener todos estos conjuntos de datos precisos.

Los piratas informáticos también usan IA—Los atacantes prueban y mejoran su malware para hacerlo resistente a las herramientas de seguridad basadas en IA. Los piratas informáticos aprenden de las herramientas de IA existentes para desarrollar ataques más avanzados y atacar sistemas de seguridad tradicionales o incluso sistemas potenciados por IA.

Fuzzing neuronal—Fuzzing es el proceso de probar grandes cantidades de datos de entrada aleatorios dentro del software para identificar sus vulnerabilidades. La fuzzing neuronal aprovecha la IA para probar rápidamente grandes cantidades de entradas aleatorias. Sin embargo, el fuzzing también tiene un lado constructivo. Los piratas informáticos pueden conocer las debilidades de un sistema objetivo mediante la recopilación de información con el poder de las redes neuronales.

Además, los piratas informáticos pueden confundir los algoritmos de seguridad mezclando los datos con los que entrenan y las señales de advertencia que buscan.

También puede haber problemas con los datos; es posible que simplemente no haya suficientes datos (por lo que las soluciones de inteligencia artificial ofrecerán resultados inexactos e incluso falsos positivos) o los ciberdelincuentes pueden manipularlos.

Inteligencia artificial en ciberseguridad: cómo se utiliza

Como ya hemos visto, la inteligencia artificial en ciberseguridad podría ser útil de múltiples formas. Veamos exactamente cómo lo utilizan las empresas de ciberseguridad hoy en día:

- para separar los problemas críticos de la actividad regular de la red, identificando actividades que podrían resultar en ataques

- para perfilar y detectar amenazas, abuso de privilegios y cuentas comprometidas

- para la caza de amenazas con el fin de prevenir ataques

- para proteger las comunicaciones por correo electrónico de sus clientes

- para predecir violaciones de seguridad y detener la actividad de bots maliciosos

- para identificar patrones y detectar desviaciones del comportamiento típico para prevenir amenazas

- para revertir ciberataques

- para escanear metadatos e información de tráfico y alertar a los administradores sobre actividades potencialmente maliciosas.

Cómo usamos la IA

La inteligencia artificial es una componente básico de la suite Heimdal ™:

Nuestra Prevención de amenazas Heimdal ™ solución, con sus dos componentes, protección de red y protección de punto final, incluye la DarkLayer GUARD ™ y Vectornorte Módulos Detection ™, que tienen IA en su núcleo. DarkLayer GUARD ™ está impulsado por nuestra inteligencia de redes neuronales «basada en caracteres» impulsada por IA y tiene una capacidad de precisión del 96% para predice las amenazas del mañana hoy.

El motor de punto final DarkLayer GUARD ™ es además la herramienta de búsqueda de amenazas DNS de punto final más avanzada del mundo y cuenta con nuestra tecnología de correlación de amenazas para procesar que le permite detectar procesos, usuarios, URL y orígenes de los atacantes utilizados para infiltrarse en su red.

El filtro DarkLayer GUARD ™ funciona en conjunto con nuestro Vectornorte Detection ™ motor de reconocimiento de patrones de tráfico basado en IA que también le brinda capacidades HIPS / HIDS e IOA / IOC y detecta malware oculto, completamente autónomo de código y firmas.

Con su ayuda, puede buscar, detectar, responder y prevenir APT, fugas de datos, ransomware, malware de red.

Nuestra Antivirus para endpoints de última generación Heimdal ™ utiliza motores heurísticos basados en el comportamiento impulsados por inteligencia artificial para monitorear los procesos y procesar los cambios y utiliza 4 etapas de escaneo para detectar e identificar incluso las amenazas más avanzadas: escaneo de archivos / firmas y registros locales, escaneo en la nube en tiempo real, Sandbox y inspección de puerta trasera, escaneo basado en el comportamiento del proceso.

La inteligencia artificial también está presente en nuestros productos que se ocupan de la seguridad del correo electrónico. Prevención de fraudes de Heimdal ™ supervisa la comunicación en busca de comunicaciones falsas y correos electrónicos maliciosos con el fin de evitar el fraude financiero y del CEO y detectar el compromiso de correo electrónico de Insider Business, y lo hace mediante 125 vectores de detección. Los más importantes son: cambios de fraseología, escaneo de IBAN / número de cuenta, modificación de archivos adjuntos, ejecución y escaneo de enlaces, detección de hombre en el correo electrónico. MailSentry Fraud Prevention es capaz de aprender los patrones de comunicación de los remitentes para detectar las modificaciones más pequeñas.

Las comunicaciones por correo electrónico son el primer punto de entrada a los sistemas de una organización.

MailSentry

es el sistema de protección de correo de siguiente nivel que protege todos sus

comunicaciones entrantes y salientes

- Escaneo profundo de contenido en busca de archivos adjuntos y enlaces;

- Ataques de phishing, spear phishing y man-in-the-email;

- Filtros de spam avanzados que protegen contra ataques sofisticados;

- Sistema de prevención de fraude contra Business Email Compromise (BEC);

Oferta válida solo para empresas.

Puede encontrar más detalles sobre este tema viendo uno de nuestro seminario web anteriors, Ingrese al futuro de la seguridad del DNS: una charla con nuestro pionero en inteligencia artificial sobre cómo romper la barrera del sonido.

Inteligencia artificial en ciberseguridad – Conclusión

La inteligencia artificial es un tema que nos ha fascinado durante mucho tiempo, aunque el matemático Alan Turing lanzó la pregunta «¿Pueden pensar las máquinas?» En la década de 1950, los rastros de personas que se preguntaban qué pasaría si intentaran producir una criatura racional se remontan a 1818, cuando Mary Shelley escribió Frankenstein. Al igual que la tecnología en sí, la inteligencia artificial puede usarse para bien o para mal, puede ayudar de grandes maneras o, en las manos equivocadas, puede provocar daños graves; solo depende de nosotros lo que hagamos con ella.

Independientemente de cómo elija utilizar la inteligencia artificial en el dominio de la ciberseguridad, recuerde que Heimdal ™ Security siempre lo respalda y que nuestro equipo está aquí para ayudarlo a proteger su hogar y su empresa y para crear una cultura de ciberseguridad en beneficio de todos. que quiera aprender más sobre él.

Escriba una línea a continuación si tiene algún comentario, pregunta o sugerencia: ¡somos todos oídos y estamos ansiosos por escuchar su opinión!