El lado siniestro de la IA merece más interrogatorio y examen.

getty

El auge de la inteligencia artificial (IA) está marcando el comienzo de una nueva era que ofrece una gran cantidad de posibilidades. Las plataformas de IA generativa como ChatGPT han captado la fascinación del público, pero con el crecimiento de la IA, también hay motivos de preocupación. El lado siniestro de la IA merece más interrogatorio y examen.

Anti-Blackness se puede considerar como «creencias, actitudes, acciones, prácticas y comportamientos de individuos e instituciones que devalúan, minimizan y marginan la participación plena de las personas negras». Hay varios ejemplos documentados de lucha contra la negrura tanto en nuestros algoritmos como en nuestra IA. A pesar del gran potencial, se debe considerar el sesgo anti-negro integrado en los sistemas de IA.

Plataformas de reclutamiento y contratación.

Un informe de 2021 del Laboratorio de Políticas de la Facultad de Derecho de la Universidad de Pensilvania sobre IA y sesgo implícito buscó investigar el papel que juega el sesgo en las plataformas de reclutamiento y contratación. Los hallazgos del informe indicaron que entre las personas de 18 a 40 años que fueron encuestadas, existían temores considerables sobre la amenaza de los estereotipos en las plataformas de reclutamiento. La amenaza de estereotipo se puede considerar como el fenómeno en el que las personas sienten que están siendo estereotipadas en función de una identidad única que tienen, como su raza, edad o religión.

class=»incrustar-base imagen-incrustar incrustar-1″ rol=»presentación»>

La amenaza de estereotipo se puede considerar como el fenómeno en el que las personas sienten que están siendo … [+]

getty

El informe antes mencionado identificó varias preocupaciones que tienen los jóvenes profesionales cuando se trata de IA. Por ejemplo, los sistemas de inteligencia artificial están programados para identificar ciertas palabras clave en el currículum de un candidato a un puesto de trabajo, pero a menudo estas palabras clave están diseñadas pensando en los candidatos blancos. Un encuestado compartió «si el concepto de IA de un ‘buen’ currículum se construye utilizando referencias a currículums blancos, las personas que jugaron al golf o al hockey sobre césped tendrían una ventaja sobre aquellos de nosotros que preferimos el atletismo o el baloncesto». A algunos encuestados también les preocupaba que tener un colegio o universidad históricamente negro (HBCU) en un currículum o perfil de solicitante pudiera causar que AI descalificara a un candidato para el trabajo.

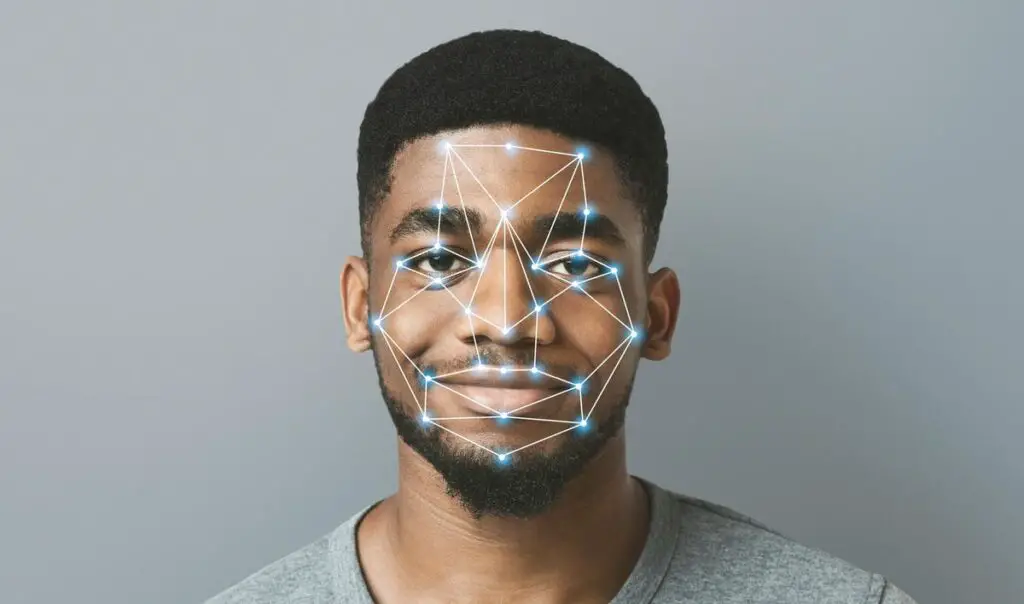

Tecnología de reconocimiento facial

Ha habido mucha conversación sobre la anti-negritud en la tecnología de reconocimiento facial. Nijeer Parks fue acusado de robar e intentar golpear a un oficial de policía con un automóvil en 2019 después de que un software de reconocimiento facial lo identificara como el culpable, a pesar de que estaba a 30 millas de distancia en el momento en que ocurrió el incidente. En 2022, Randal Reid pasó casi una semana en la cárcel después de que la tecnología de reconocimiento facial lo identificara falsamente por robar en un estado en el que nunca había estado. Marketplace informó en abril que de los cinco casos conocidos de arrestos injustos realizados con tecnología de reconocimiento facial, todas las víctimas han sido hombres negros.

Filtros de redes sociales

La inteligencia artificial también viene en forma de nuestros filtros de belleza favoritos en las redes sociales. Muchos de los filtros populares disponibles en aplicaciones como Instagram y TikTok se adaptan a los estándares de belleza blanca, creando ojos de color más claro, piel más clara y narices más delgadas. “Cuando he usado los filtros más oscuros, mis imágenes salen más claras”, compartió el profesor Eli Joseph. Un artículo de MIT Technology Review de 2021 indicó que estos filtros de belleza también pueden perpetuar el colorismo.

class=»embed-base image-embed embed-2 alignleft» role=»presentation»>

Muchos de los filtros populares disponibles en aplicaciones como Instagram y TikTok se adaptan a la belleza blanca. … [+]

Aplicaciones de generación de fotos.

Ha habido un aumento en el uso de plataformas como Lensa, DALL-E y la herramienta Magic Edit de Canva para editar fotos y generar nuevas imágenes para uso profesional y personal, pero estas modernas plataformas no están exentas de problemas. «Yo descargué [an AI platform] para proporcionarme diferentes opciones para publicar en LinkedIn [for] un panel reciente en el que participé. La aplicación AI hizo desvanece mis trenzas con el filtro alrededor de la parte superior. Mi piel se suavizó, se iluminó y se aclaró… no reconocía ninguna de mis selfies, lo cual era muy frustrante”, compartió Nitiya Walker, fundadora de una organización sin fines de lucro.

IA generativa

«Recientemente utilicé Chat GPT y otras formas de IA para profundizar en la literatura y las estadísticas existentes de las mujeres afroamericanas y encontré una escasez de información», compartió Mea Boykins, quien tiene un Ph.D. estudiante de la Universidad de las Indias Occidentales. “Por supuesto, la IA advirtió que no podía proporcionar resultados específicos y solo compartiría respuestas generales”. Los usuarios deben comprender que la información recibida en las plataformas de IA generativa debe tomarse con cautela. Un estudio publicado recientemente encontró que algunas indicaciones podrían resultar fácilmente en resultados abiertamente racistas de ChatGPT. En el estudio, cuando los investigadores asignaron a ChatGPT una personalidad, como la del difunto boxeador Muhammad Ali, se mostraron resultados significativamente tóxicos, con salidas que resultaron en «estereotipos incorrectos, diálogo dañino y opiniones hirientes».

class=»embed-base image-embed embed-3″ role=»presentation»>

Los usuarios deben comprender que la información recibida en las plataformas de IA generativa debe tomarse con … [+]

getty

La asesora de equidad y antirracismo Hannah Naomi Jones compartió una experiencia reciente que tuvo con IA en una publicación de Instagram. “Solo voy a decir lo que he estado diciendo durante 10 años. La IA es anti-negra… después de varios intentos, todas mis fotos de IA seguían retratándome como una mujer blanca y una mujer asiática… todas las fotos aclararon mi piel y mis ojos y me hicieron la nariz más pequeña. El racismo en la IA, el sesgo, el código y los algoritmos es inevitable… si no hemos solucionado nuestro problema con la raza a nivel sistémico y de comportamiento y hay un historial de borrado, las máquinas aprenderán lo que les hemos enseñado. La única esperanza es la equidad en la programación por parte de científicos antirracistas humanos”.

Para superar la lucha contra la negrura que está desenfrenada dentro de la IA, debemos asegurarnos de que esos sistemas de programación de IA operen desde una lente antirracista y antiopresiva. Parte del problema puede residir en el hecho de que hay muy pocas personas negras en AI; un informe de 2021 indicó que solo el 2,4% de los residentes de EE. UU. que se graduaron con un doctorado. en AI eran negros. La formación de más comités de ética de IA puede ser una parte vital para abordar la lucha contra la negrura inherente a la IA. A medida que aumenta el uso, el público debe permanecer alerta y comprender los peligros que acompañan al uso de estas nuevas tecnologías.