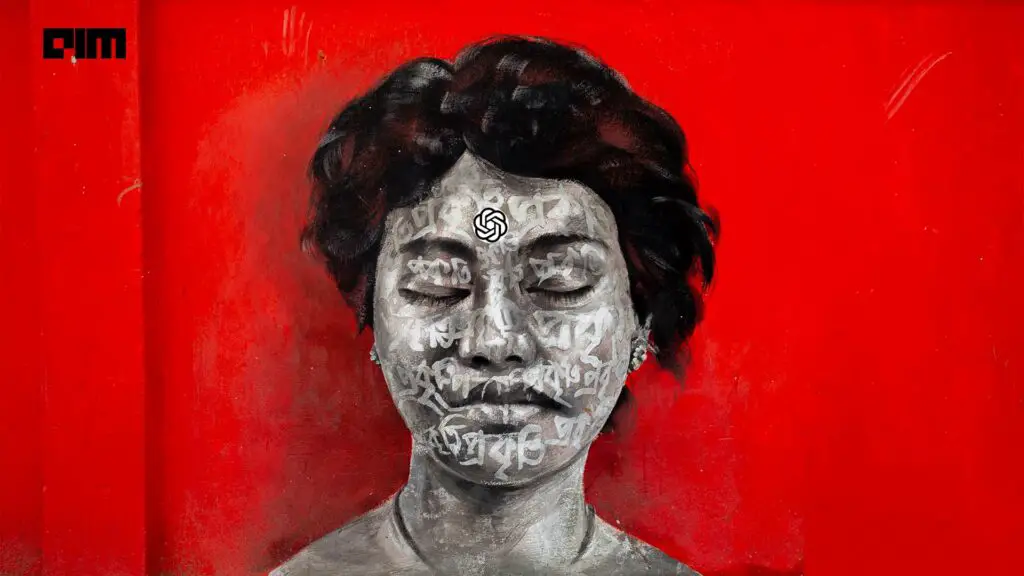

En 2019, Irene Solaiman fue una de las primeras personas que comenzó a cuestionar y a trabajar en la investigación del impacto social y el sesgo de los modelos de lenguaje extenso (LLM). En una entrevista exclusiva que indica su herencia de Bangladesh, le dijo a AIM, mientras estaba en OpenAI, «comenzó a generar GPT-2 y GPT-3 en bengalí».

“Hasta donde yo sé, esta es la única prueba en un idioma de caracteres no latinos de una publicación de OpenAI. Google ha comenzado a hacer lo mismo con Bard. No estoy segura de dónde viene esta correlación, pero la representación de los investigadores es muy útil”, agregó.

Actualmente, Solaiman es directora de políticas en Hugging Face y una gran parte de su corazón está en la investigación; que es seguro, ético y responsable para diferentes grupos culturales. Después de estudiar la política de derechos humanos, Solaiman se dio cuenta de que leer las violaciones de los derechos humanos 12 horas al día es agotador. Así que aprendió a codificar y pasó directamente de la escuela de posgrado a OpenAI, que estaba pasando de ser una organización sin fines de lucro.

Paradoja de desalineación de valores

Solaiman ama ‘Star Trek: La próxima generación’. Ella dijo: “Deberíamos ser conscientes de los peligros, pero también de las novelas distópicas. Varias veces reflejan eventos históricos, y es importante referirse a ellos en lugar de a la ciencia ficción”.

Ella sugirió basarnos en cómo las personas usan los sistemas, los efectos de los problemas sistémicos y cómo la IA puede usarse para crear bondad pero también exacerbar la inequidad social.

El experto en seguridad no es fanático del lenguaje orientado a la solución y afirma que la alineación de valores culturales nunca se resolverá. “Siempre vamos a averiguar cómo empoderar a diferentes grupos de personas. Cuando tratas a un grupo de personas como un todo, escucharás más alto a las personas con la mayor plataforma o privilegio. La retroalimentación es notoriamente difícil. Incluso si logramos algo increíblemente poderoso, tener mecanismos de retroalimentación iterativos y continuos será un proceso continuo”, dijo.

El problema de la alineación mantiene a muchos investigadores despiertos por la noche como Solaiman. Recientemente, mientras hablaba con AIM, el aclamado pensador Nick Bostrom reflexionó: «¿Cómo nos aseguramos de que los sistemas altamente capaces cognitivamente, y eventualmente las IA superinteligentes, hagan lo que sus diseñadores pretenden que hagan?». Bostrom ha profundizado en el problema técnico sin resolver en su libro ‘Super Intelligence’ para llamar más la atención sobre el tema. Mientras tanto, el ejemplo más infame de IA desalineada es el BlenderBot racista de Meta que odiaba a Mark Zuckerberg.

Leer más: ‘Dolor en las IA’ de Nick Bostrom

Solaiman habla activamente sobre el problema de alineación. Para ella, es importante comprender cómo son los mecanismos de retroalimentación para las partes del mundo donde se implementan los sistemas, pero que no necesariamente tienen ese aporte directo al desarrollo (como India).

La creciente politización le preocupa, dijo, refiriéndose al RightWingGPT blanco que afirma que los sistemas están demasiado despiertos cuando afinó algunos modelos de lenguaje en los marcos de derechos humanos.

“Es una locura para mí que los derechos humanos se consideren despiertos. Necesitamos tener una mejor comprensión de lo que es simplemente divertido y lo que fundamentalmente debe codificarse en los sistemas para respetar los derechos de las personas”. dijo la experta en seguridad de IA mientras aconseja empoderar a no sobrescribir diferentes culturas.

OpenAI frente a código abierto

Cuando llegó a Hugging Face en abril de 2022, Solaiman no tenía experiencia en código abierto. “Estaba asombrada y enamorada de cómo el código abierto empodera a diferentes grupos en todo el mundo que a menudo no tienen acceso a estos sistemas para contribuir”, dijo.

La gran parte de sus preguntas sobre el acceso y liberación de modelos es qué significa hacer que un modelo sea más abierto. Simplemente liberar pesas de modelos no es lo más accesible, opinó. «Cuando lanzamos GPT-2, abrimos los pesos del modelo, pero fue Hugging Face quien creó la interfaz ‘Write with Transformers’ que la gente, incluido yo mismo, comenzamos a usar, especialmente en una época en la que las personas podrían no verse afectadas por la IA». Añadido entusiasta de HF.

La investigación actual

Solaiman compartió que existe una intensa presión sobre las personas en las humanidades para dominar la informática. Tener habilidades de programación le da una idea de un sistema que de otro modo no tendría. “Pero esta capacitación debe venir de ambos lados para que la investigación verdaderamente interdisciplinaria funcione. Debe haber respeto y una integración de las personas que trabajan en seguridad y ética en esos equipos de desarrolladores. Me siento menos capacitado para hacer mi trabajo cuando estoy aislado y tengo menos acceso a la infraestructura de ingeniería.

Actualmente, Solaiman dedica un tercio de su tiempo a desarrollar todo, desde políticas públicas hasta garantizar que las nuevas regulaciones estén técnicamente informadas. Muchas veces, los formuladores de políticas tienen que usar muchos sombreros y es posible que no tengan ese nivel de comprensión de lo que es técnicamente factible. Guiar eso en este momento es principalmente con los gobiernos occidentales. Pero deseando tener más compromiso con el resto del mundo.

Los otros dos tercios de su trabajo son de investigación. “Hay un ecosistema multifacético de lo que hace que los sistemas sean mejores. Tienes que trabajar con formuladores de políticas que puedan coordinar el interés público. Pero también solo hay que entender estos sistemas, saber evaluar sus comportamientos y sus impactos”, agregó.

“No temo que, a corto plazo, los sistemas de IA se vuelvan deshonestos porque las personas otorgan su poder a los sistemas técnicos. Hemos conectado gran parte de nuestra vida personal a las redes sociales con nuestras cuentas bancarias. No temo que los sistemas de IA tengan acceso a los códigos nucleares. Temo que la gente le dé a los sistemas técnicos o sistemas autónomos este increíble poder y acceso. Así que es muy importante centrarse en el aspecto humano”. concluyó al mencionar la necesidad de regulaciones de IA.