Elon Musk y un grupo de expertos en inteligencia artificial y ejecutivos de la industria piden una pausa de seis meses en el desarrollo de sistemas más potentes que el recientemente lanzado GPT-4 de OpenAI, en una carta abierta que cita riesgos potenciales para la sociedad y la humanidad.

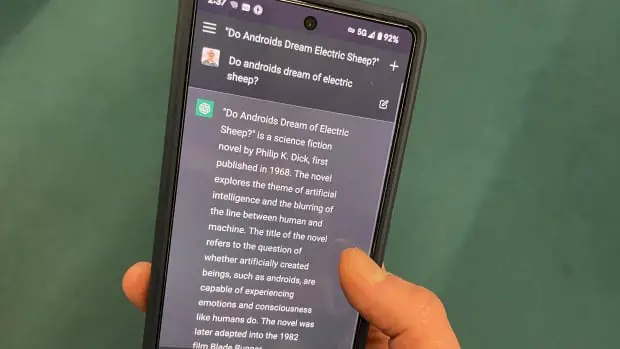

A principios de este mes, OpenAI, respaldado por Microsoft, presentó la cuarta versión de su programa de IA GPT (Generative Pre-trained Transformer), que ha cautivado a los usuarios con su amplia gama de aplicaciones, desde involucrar a los usuarios en conversaciones similares a las de los humanos hasta componer canciones y resumir largas documentos.

La carta, emitida por el Future of Life Institute sin fines de lucro y firmada por más de 1,000 personas, incluido Musk, pedía una pausa en el desarrollo avanzado de IA hasta que expertos independientes desarrollaran, implementaran y auditaran protocolos de seguridad compartidos para tales diseños.

“Los poderosos sistemas de inteligencia artificial deben desarrollarse solo una vez que estemos seguros de que sus efectos serán positivos y sus riesgos serán manejables”, decía la carta.

OpenAI no respondió de inmediato a una solicitud de comentarios.

Elon Musk y los expertos en tecnología piden una pausa en el desarrollo de la IA

En una carta abierta que cita los riesgos para la sociedad, Elon Musk y un grupo de expertos en inteligencia artificial y ejecutivos de la industria piden una pausa de seis meses en el desarrollo de sistemas más potentes que el recientemente lanzado GPT-4 de OpenAI. Algunos expertos en Canadá también están poniendo su nombre en esa lista.

La carta detallaba los riesgos potenciales para la sociedad y la civilización de los sistemas de IA competitivos entre humanos en forma de interrupciones económicas y políticas, y pedía a los desarrolladores que trabajaran con los legisladores en materia de gobernanza y autoridades reguladoras.

Los cosignatarios incluyeron al CEO de Stability AI, Emad Mostaque, investigadores de DeepMind, propiedad de Alphabet, y los pesos pesados de AI Yoshua Bengio, a menudo denominado como uno de los «padrinos de AI», y Stuart Russell, un pionero de la investigación en el campo.

Según el registro de transparencia de la Unión Europea, el Instituto Future of Life está financiado principalmente por la Fundación Musk, así como por el grupo de altruismo efectivo Founders Pledge con sede en Londres y la Fundación Comunitaria de Silicon Valley.

Mal uso potencial

Las preocupaciones surgen cuando la fuerza policial de la UE, Europol, se unió el lunes a un coro de preocupaciones éticas y legales sobre IA avanzada como ChatGPT, advirtiendo sobre el posible uso indebido del sistema en intentos de phishing, desinformación y ciberdelincuencia.

Mientras tanto, el gobierno del Reino Unido dio a conocer propuestas para un marco regulatorio «adaptable» en torno a la IA.

El enfoque del gobierno, descrito en un documento de política publicado el miércoles, dividiría la responsabilidad de gobernar la inteligencia artificial (IA) entre sus reguladores de derechos humanos, salud y seguridad y competencia, en lugar de crear un nuevo organismo dedicado a la tecnología.

Musk, cuyo fabricante de automóviles Tesla está utilizando IA para un sistema de piloto automático, ha expresado sus preocupaciones sobre la IA.

Desde su lanzamiento el año pasado, ChatGPT de OpenAI ha llevado a los rivales a acelerar el desarrollo de modelos de lenguaje grandes similares y a las empresas a integrar modelos de IA generativa en sus productos.

RELOJ | ¿Viene ChatGPT por tu trabajo?

¿Viene ChatGPT por tu trabajo?

La semana pasada, OpenAI anunció que se había asociado con alrededor de una docena de empresas para incorporar sus servicios en su chatbot, lo que permite a los usuarios de ChatGPT pedir comestibles a través de Instacart o reservar vuelos a través de Expedia.

‘Tenemos que reducir la velocidad’

Sam Altman, director ejecutivo de OpenAI, no ha firmado la carta, dijo a Reuters un portavoz de Future of Life.

«La carta no es perfecta, pero el espíritu es correcto: debemos reducir la velocidad hasta que entendamos mejor las ramificaciones», dijo Gary Marcus, profesor de la Universidad de Nueva York que firmó la carta. «Los grandes jugadores se están volviendo cada vez más reservados sobre lo que están haciendo, lo que dificulta que la sociedad se defienda de cualquier daño que pueda materializarse».

Los críticos acusaron a los firmantes de la carta de promover el «bombo de la IA», argumentando que las afirmaciones sobre el potencial actual de la tecnología habían sido muy exageradas.

«Este tipo de declaraciones están destinadas a generar entusiasmo. Están destinadas a preocupar a la gente», Johanna Björklund, investigadora de IA y profesora asociada en la Universidad de Umeå. «No creo que haya necesidad de tirar del freno de mano».

En lugar de detener la investigación, dijo, los investigadores de IA deberían estar sujetos a mayores requisitos de transparencia.

«Si realiza una investigación de IA, debe ser muy transparente sobre cómo lo hace».