La semana pasada, Meta presentó Llama 2, un nuevo modelo de lenguaje grande con hasta 70 mil millones de parámetros. El nuevo sistema generativo de IA representa un tiro espectacular en la proa de OpenAI, que comparte algunos detalles sobre la mayoría de los modelos de IA, incluidos GPT-3/3.5 y GPT-4. El lanzamiento de Llama 2, con el 40 por ciento de los parámetros de ChatGPT 3.5, según Wikipedia, incluyó una asociación destacada con Microsoft. Y Redmond no es solo un socio nominal, ya que recientemente anunció soporte para Llama 2 en Azure y Windows. Mientras tanto, Qualcomm ahora dice que está entrando en la refriega LLM con Llama 2, revelando planes para llevar Llama 2 a los teléfonos inteligentes.

Un poco más polémica es la afirmación de Meta de que Llama 2 es de código abierto. Meta y Microsoft ciertamente promocionan las credenciales de código abierto del nuevo Llama. (Algunos desarrolladores de código abierto, por otro lado, discrepan).

La licencia de Llama 2 es un multiplicador de fuerza, que brinda a los desarrolladores e investigadores la oportunidad de ajustar el modelo para sus necesidades específicas.

Los desarrollos de la semana pasada significan, cualquiera que sea el origen, una expansión dramática en la capacidad y el alcance de los modelos de IA de código abierto.

«Oh, esto es mucho mejor», dice Aravind Srinivas, cofundador y director ejecutivo de Perplexity.ai. “Ya sea que coincidan con GPT 3.5 o no 1690226111Es solo cuestión de tiempo.»

Llama 2: afinado y listo para chatear

Perplexity.ai ofrece una impresionante demostración en línea gratuita de varios modelos de Llama 2. Sus resultados son competitivos con los mejores chatbots de la actualidad, incluidos ChatGPT y Google Bard. Llama 2 genera rápidamente texto limpio y natural que, aunque es poco probable que gane premios, es fácil de leer y comprender. Llama 2 también puede producir hechos comúnmente entendidos, generar código y resolver ecuaciones matemáticas.

Llama 2, como todos los LLM, ocasionalmente generará respuestas incorrectas o inutilizables, pero el artículo de Meta que presenta Llama 2 afirma que está a la par con GPT 3.5 de OpenAI en puntos de referencia académicos como MMLU (que mide el conocimiento de un LLM en 57 materias STEM) y GSM8K (que mide la comprensión de matemáticas de un LLM).

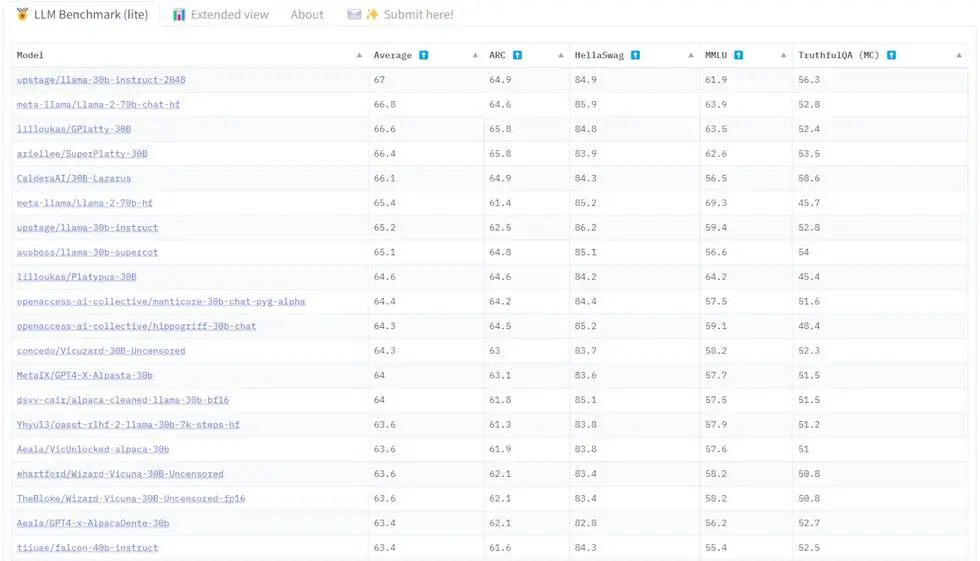

La mayoría de los modelos pequeños que superan a Llama 2 en la clasificación de Open LLM se basan en el modelo anterior de Meta, Llama.

Los investigadores de Meta lograron esto parcialmente a través del tamaño del modelo, pero eso es solo la mitad de la historia. Llama 2 utiliza un ajuste fino supervisado, aprendizaje reforzado con retroalimentación humana y una técnica novedosa llamada Ghost Attention (GAtt) que, según el artículo de Meta, «permite el control del diálogo en múltiples turnos». En pocas palabras, GAtt ayuda a Llama 2 a generar los resultados deseados cuando se le pide que trabaje dentro de una restricción específica, como podría ocurrir cuando se le pide que «actúe como» una figura histórica, o que produzca respuestas dentro del contexto de un tema específico, como la arquitectura.

La “Atención fantasma” de Llama 2, dicen los promotores del LLM, ayuda al modelo a brindar resultados conversacionales que se ajustan a las restricciones definidas por el usuario. Meta

Estas técnicas ayudan a Llama 2 a ofrecer una amplia gama de modelos con un rendimiento de referencia sólido en relación con su tamaño. El modelo más grande, Llama 2 70B (con 70 mil millones de parámetros), funciona mejor en todos los puntos de referencia, pero Meta también ofrece Llama 2 7B y Llama 2 13B.

Las variantes con menos parámetros no funcionan tan bien como Llama 2 70B, pero son lo suficientemente compactas como para ejecutarse localmente en dispositivos menos potentes, como teléfonos inteligentes. Qualcomm, un productor líder de sistemas en un chip (SoC) para teléfonos inteligentes, anunció una asociación con Meta para que Llama 2 se ejecute localmente en teléfonos inteligentes con tecnología Qualcomm «a partir de 2024».

“Podemos usar nuestras herramientas de software para compilar y optimizar el modelo específicamente para ejecutarlo en nuestro procesador Hexagon”, dice Rodrigo Caruso Neves do Amaral, especialista en comunicaciones de marketing de Qualcomm. “La cantidad de energía que se ahorra al ejecutar el dispositivo tiene un gran impacto, ya sea para las empresas que ejecutan estos modelos o para el consumidor que a veces tendría que pagar para tener acceso a estas aplicaciones”.

El código abierto encaja donde los modelos cerrados no pueden

Ejecutar un modelo de lenguaje grande sin conexión en un teléfono inteligente es algo que los modelos de IA cerrados (como GPT 3.5 de OpenAI y PaLM2 de Google) no pueden manejar. Esto no se debe necesariamente a limitaciones técnicas (presumiblemente, OpenAI y Google podría ofrecer un modelo adecuado para un teléfono inteligente), sino una división filosófica. OpenAI y Google proporcionan LLM como una API. Se requiere una conexión a Internet para acceder a la API, y los clientes pagan según el uso.

Llama 2, por el contrario, se lanzó con una licencia que permite un uso comercial y académico ilimitado y gratuito. La licencia no cumple con todos los estándares establecidos por Open Source Initiative, ya que la licencia incluye una cláusula que requiere permiso para usar Llama 2 para «productos o servicios» con «más de 700 millones de usuarios activos mensuales». Sin embargo, esta cláusula solo es relevante para los principales competidores de Meta, como OpenAI y Google. Los modelos Llama 2 de Meta ya aparecen en la tabla de clasificación Open LLM de HuggingFace, con «llama-2-70b-chat-hf» reclamando el tercer mejor desempeño en latencia y puntos de referencia de rendimiento, al cierre del lunes 24 de julio. (Los desarrolladores de IA están explotando rápidamente el potencial de Llama 2: el modelo superior actual al momento de la publicación, FreeWilly2 de Stability AI, de hecho ya está basado en Llama 2, pero FreeWilly2 ajusta el modelo con un conjunto de datos diferente).

A partir del 21 de julio, la tabla de clasificación OpenLLM del agregador de IA HuggingFace colocó a «llama-2-70b-chat-hf» como el segundo mejor desempeño entre todos los LLM abiertos en métricas de rendimiento y latencia. AbrazandoCara

A partir del 21 de julio, la tabla de clasificación OpenLLM del agregador de IA HuggingFace colocó a «llama-2-70b-chat-hf» como el segundo mejor desempeño entre todos los LLM abiertos en métricas de rendimiento y latencia. AbrazandoCara

Srinivas ve la licencia de código abierto de Llama 2 como un multiplicador de fuerza, brindando a los desarrolladores e investigadores la oportunidad de ajustar el modelo para sus necesidades específicas. “Una persona puede comenzar una bifurcación de Llama 2 donde se enfoca en la cuantificación, otra persona puede comenzar una bifurcación de Llama donde se enfoca en el ajuste fino de rango bajo, […] otra persona puede trabajar en la destilación de modelos más grandes en modelos más pequeños. El progreso simplemente se acelera”.

Esto resultará particularmente relevante para los desarrolladores que apuntan a dispositivos periféricos, como los teléfonos inteligentes. El hecho de que Llama 2 70B funcione bien no es una gran sorpresa, dado el tamaño del modelo. Pero los modelos más pequeños de Llama 2 también se clasifican bien en relación con el tamaño de su modelo. Y la mayoría de los modelos pequeños que superan a Llama 2 en la clasificación de Open LLM se basan en el modelo anterior de Meta, Llama. Eso sugiere que Llama 2 subirá en las listas a medida que los desarrolladores de la comunidad de código abierto apliquen sus talentos a Llama 2.

«Creo que [Llama 2 7B and Llama 2 13B] ya son emocionantes. … Esto es solo el comienzo, ¿verdad? [Meta] apagarlo, y ahora la gente puede mejorarlo”, dice Srinivas. “Se pueden construir otros marcos y otras capas de ingeniería, y esto les da más poder a todos”.

De los artículos de su sitio

Artículos relacionados en la Web