Desde el lanzamiento de ChatGPT en noviembre de 2022, OpenAI ha recibido mucha atención de los trabajadores del conocimiento, los desarrolladores y casi todos los que usan Internet y la web. Pero OpenAI existe desde hace mucho tiempo, incluso antes de que se creara ChatGPT, y ofrece muchos servicios interesantes a los desarrolladores. Es una de las primeras empresas de plataformas en exponer la IA generativa a través de puntos finales simples de API REST.

Este será el primero de una serie de artículos sobre OpenAI donde exploraremos el panorama general de OpenAI y cómo está estructurada la plataforma. Comprenderemos los cimientos y los componentes básicos de la plataforma OpenAI.

OpenAI: Democratización de la IA generativa

OpenAI se estableció en 2015 como una organización de investigación sin fines de lucro por Ilya Sutskever, Greg Brockman, Trevor Blackwell, Vicki Cheung, Andrej Karpathy, Durk Kingma, John Schulman, Pamela Vagata y Wojciech Zaremba. Sam Altman y Elon Musk fueron los miembros iniciales de la junta.

OpenAI se convirtió en el centro de atención cuando Microsoft anunció una inversión de $ 1 mil millones en 2019 y otra ronda de $ 10 mil millones a principios de este año. Infosys y Khosla Ventures son los inversores corporativos, mientras que Reid Hoffman, Peter Thiel y Jessica Livingston son los inversores individuales.

Aunque a menudo se le critica por pasar de ser una empresa sin fines de lucro a una empresa comercial de IA, OpenAI ha estado a la vanguardia de la investigación de IA generativa. Gracias a la asociación de Microsoft, obtuvo acceso a la infraestructura de última generación impulsada por los servicios informáticos de Azure.

Sin dedicar demasiado tiempo a comprender la historia y la evolución de OpenAI, veamos el estado actual de la empresa.

Los modelos generativos de IA se entrenan con grandes conjuntos de datos basados en aprendizaje no supervisado llamados modelos básicos. En un nivel alto, OpenAI tiene tres modelos básicos clave: GPT, DALL-E y Whisper. GPT es uno de los modelos más populares capacitados para manejar contenido textual. DALL-E puede generar imágenes basadas en la entrada de lenguaje natural. Finalmente, Whisper es un modelo para convertir voz en texto y traducir de un idioma a otro.

Todos los casos de uso y escenarios de IA generativa compatibles con OpenAI giran en torno a estos tres modelos básicos. De estos, GPT obtuvo la máxima atención debido al éxito de ChatGPT, que funciona con la versión más reciente del modelo: GPT-4. Existen múltiples variaciones del modelo GPT para admitir escenarios como la finalización de palabras, el chat interactivo, la edición, la reformulación, el resumen y la clasificación de texto. Del mismo modo, DALL-E se puede utilizar para crear, editar y crear variaciones de imágenes. El modelo Whisper se puede utilizar para la transcripción y traducción de archivos de audio.

Para facilitar a los desarrolladores la infusión de IA generativa, OpenAI ha expuesto múltiples API alineadas con los casos de uso. Para integrar modelos como GPT o DALL-E, los desarrolladores deberán obtener la clave API y usarla para acceder a los puntos finales Open AI REST.

Las API de OpenAI democratizaron la IA generativa al hacer que los modelos de visión y lenguaje de última generación fueran accesibles a través de una interfaz REST simple. Cualquier desarrollador familiarizado con el consumo de API puede infundir el poder de la IA generativa en sus aplicaciones. No necesitan comprender las complejas matemáticas que hay detrás de las redes neuronales ni tener acceso a una potente infraestructura informática basada en CPU y GPU de gama alta.

Es posible ajustar los modelos básicos de OpenAI con conjuntos de datos privados personalizados. Luego, el modelo ajustado se puede usar para realizar inferencias en datos privados, lo que mejora significativamente el valor de la IA generativa. OpenAI ha expuesto el ajuste fino como una API que acepta la variación de un modelo básico y un conjunto de datos personalizado.

El siguiente diagrama resume cómo está estructurada la plataforma OpenAI. La capa más inferior consiste en los modelos básicos, mientras que la siguiente capa tiene múltiples sabores y variaciones de los modelos, cada uno optimizado para un caso de uso específico. La capa superior es la API REST que expone los modelos a través de puntos finales conocidos.

Explorando el ecosistema OpenAI

OpenAI ha creado herramientas, SDK y servicios dirigidos a desarrolladores y usuarios finales. ChatGPT es un ejemplo de un servicio dirigido a usuarios finales. OpenAI utiliza predominantemente ChatGPT para obtener comentarios interactivos de los usuarios, lo que contribuye en gran medida a mejorar el modelo GPT. También utiliza la entrada y las indicaciones para analizar cómo interactúan los usuarios con el modelo.

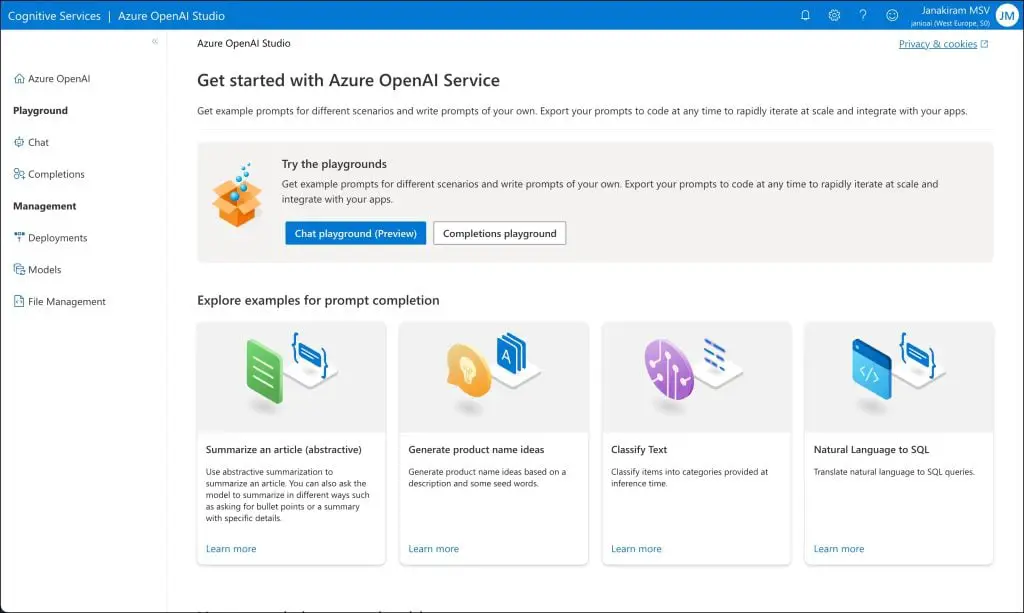

Para los desarrolladores, OpenAI tiene un área de juegos que actúa como una interfaz interactiva para la API REST. Se puede usar para probar cómo los modelos ajustados responden a la misma entrada o indicación. También se puede utilizar para modificar los parámetros que influyen en la precisión y creatividad de los modelos.

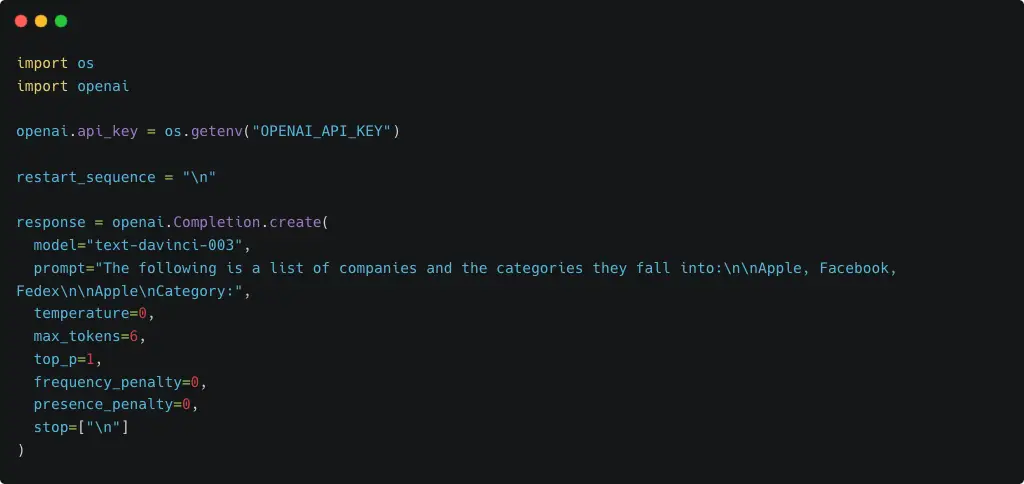

Si bien usar una herramienta como cURL para invocar la API REST es simple, OpenAI tiene una biblioteca oficial de Python que facilita el consumo de la API en entornos como Jupyter Notebook. Hay una herramienta de biblioteca oficial de Node.js para aquellos interesados en usar JavaScript. La comunidad OSS ha creado varias bibliotecas para lenguajes como C#, C++, Go, Kotlin y Swift.

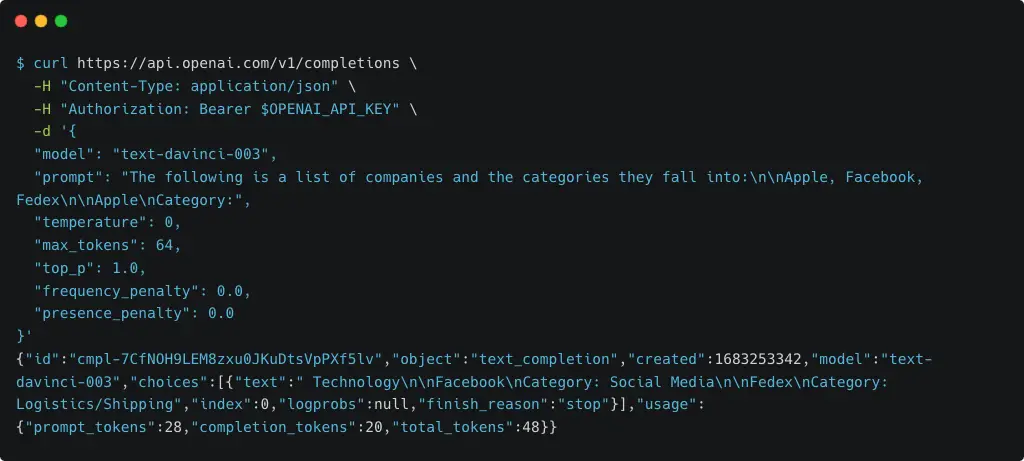

La siguiente captura de pantalla muestra la invocación de la API de finalización a través de cURL:

Lo mismo se puede hacer a través de la biblioteca oficial de Python mantenida por OpenAI.

OpenAI también ha publicado herramientas y bibliotecas que convierten palabras en tokens, la unidad de entrada fundamental de grandes modelos de lenguaje como GPT. Estas herramientas ayudan a los desarrolladores a evaluar el costo que implica consumir la API de OpenAI. Cuando instala la biblioteca de Python a través de PIP, también obtiene una práctica herramienta CLI para probar la API.

Si es un desarrollador de Microsoft Azure, puede registrarse en el servicio Azure OpenAI que está estrechamente integrado con los servicios en la nube de Microsoft, como Active Directory, redes virtuales, controles de acceso basados en roles y más.

En la siguiente parte de esta serie, analizaremos más de cerca la ingeniería rápida y su importancia al tratar con GPT. Manténganse al tanto.