Un nuevo informe impactante arroja luz sobre cómo las empresas de tecnología están admitiendo el hecho de que sus algoritmos pueden perpetuar preocupaciones graves como la discriminación.

Un ejemplo común es un artista que se hace llamar Stephanie Dinkins, que ha sido un nombre destacado en la industria durante tanto tiempo. No solo produce grandes piezas, sino que también es conocida por seleccionar productos especiales fusionando el arte con la tecnología moderna.

Ha sido ganadora de numerosos premios y tiene un nombre que se enorgullece de todo tipo de innovaciones revolucionarias en las que también ha obtenido recompensas en efectivo.

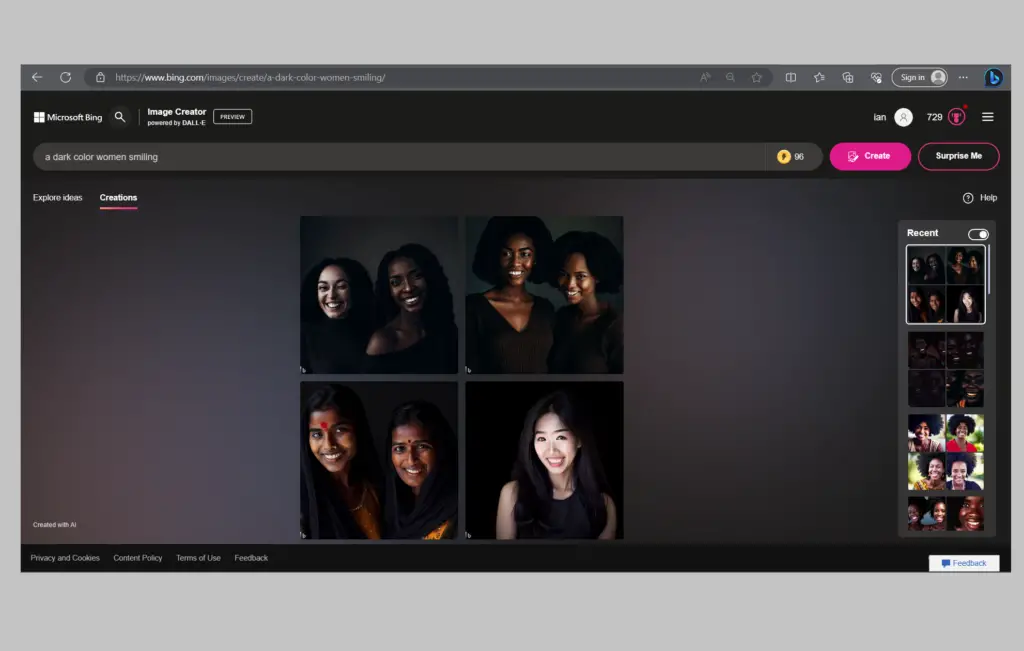

En la última década más o menos, la hemos visto aprovechar al máximo la tecnología de inteligencia artificial y realmente mostrar a las mujeres negras en todas las luces. Desde la felicidad y las celebraciones hasta la tristeza, el dolor, la pena y la preocupación también, lo que sea y ella lo logrará.

¿Mencionamos la larga lista de entrevistas en las que también ha sido cuestionada sobre su trabajo, talento y puras obras maestras? Pero espera, no todo es positivo.

Se vio a los críticos hablar sobre cómo su amor por la IA que representa emociones realistas puede ser súper alarmante, sin mencionar que es falso. Por ejemplo, encontrará sus algoritmos específicos que sacan a los humanos en tonos rosados y luego los cubren con capas de tonos negros también.

Esperaba que llegara el día en que la llamaran y la cuestionaran por su arte. Además, dice que sus piezas iniciales fueron solo experimentos y que, con el tiempo, sabía que mejoraría cada vez más.

Según ella, no es difícil hacer que una herramienta de IA produzca la imagen deseada a través de algunas indicaciones de texto específicas. Según sus palabras, la máquina le estaba dando todo lo que necesitaba, pero las distorsiones siempre están ahí.

Por ejemplo, cuando usa palabras como afroamericanos o mujeres negras indistintamente, las características son muy diferentes. Todo se distorsiona un poco y los problemas surgen a un ritmo más alto de lo esperado.

Para ella, todo es un poco impactante, pero se ha acostumbrado a serlo, pero espera que pronto surja un cambio porque la discriminación parece estar surgiendo a un ritmo más alto de lo normal. Para ella, el sesgo que produce el sistema es un factor preocupante y alarmante.

Ella espera que el sistema algún día pueda entender qué son exactamente las mujeres negras para que no se sienta matizada.

Pero se sorprenderá de cómo este famoso artista no está solo cuando se trata de plantear preguntas difíciles sobre una relación distorsionada entre la raza y el mundo de la IA. Hay muchas personas en este mundo que confirmaron que la inteligencia de IA es racista y está sesgada.

El problema es que los datos proporcionados para entrenar los algoritmos mientras se producen imágenes y las máquinas en las que funcionan dichos programas son de esta categoría.

Las tecnologías de IA podrían estar ignorando o alterando el mensaje de texto real presentado en términos de cómo retratar a un negro en una imagen. Mientras que en otros casos, podrían estar censurando tanto las culturas como su pasado.

Hemos visto que este tema es objeto de debate durante años. Desde tecnología que reconoce una cara hasta otras que tienen dificultades para comprender sus patrones de habla únicos, la lista puede continuar durante días. Y cada vez son más los estudios e investigaciones que plantean dudas vinculadas tanto al sesgo como a la igualdad.

Ahora, la pregunta es cuál es la solución. Tenemos gigantes tecnológicos de primer nivel trabajando detrás de algunos de los mayores generadores de IA. Desde Midjourney hasta OpenAI, todos admiten que hay un problema. Y todos ellos también se han comprometido a mejorar las herramientas disponibles. Según ellos, el sesgo es un gran problema que está devorando a toda la industria y debe haber un cambio para evitarlo.

Se vio a OpenAI hablando durante una entrevista publicada recientemente en la que esperaba reducir la prevalencia de dicho sesgo al tiempo que intentaba mejorar el rendimiento al mismo tiempo. Pero no está del todo claro qué está haciendo exactamente y cuántos miembros de su equipo han sido delegados para trabajar en una tarea tan enorme y completa.

Por ahora, solo tendremos que esperar y observar porque definitivamente no es algo que pueda ignorarse ni arreglarse de la noche a la mañana. ¿Qué opinas?

Imagen: DIW. Historia H/T: The New York Times

Lea a continuación: Este nuevo estudio revela cómo se siente la gente acerca de la IA que hace juicios morales